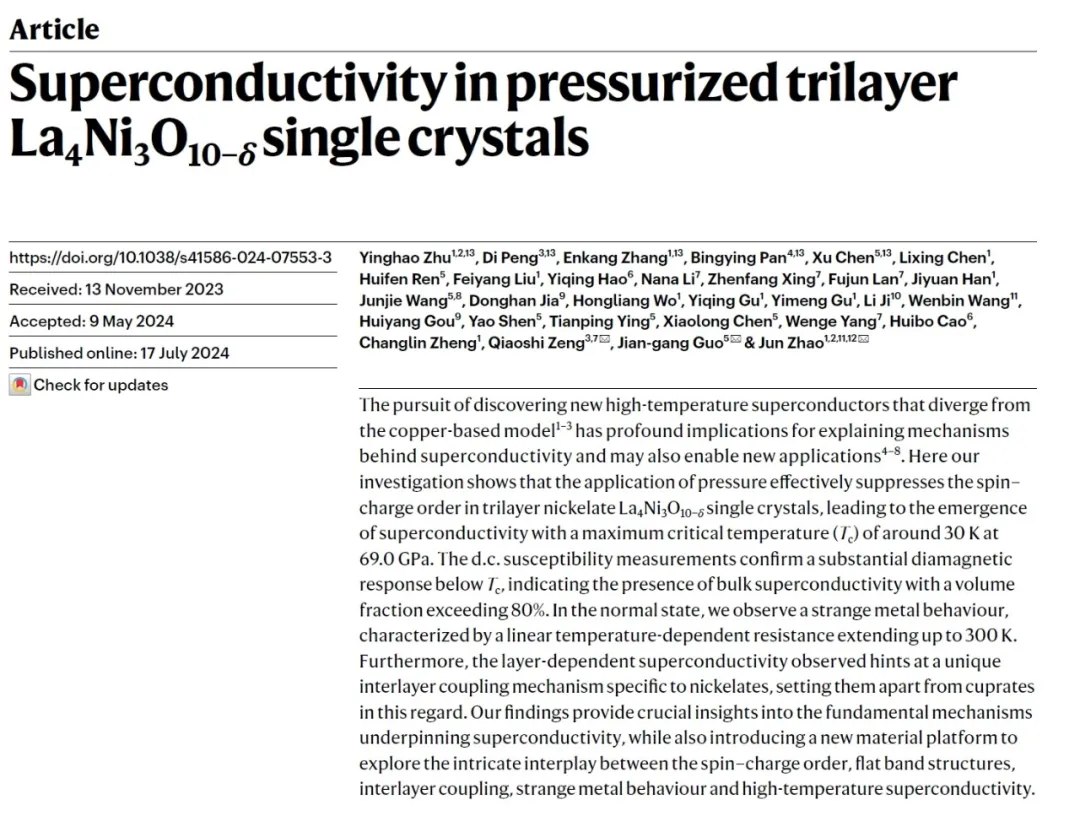

谁是最会做题大模型?“高考评测”来了

2024年全国高考的“硝烟”刚刚散去不久,“大模型考生”就被抓回来重新“做题”了。

市面上涌现出的大模型产品让人眼花缭乱,围绕“大模型技术哪家强”的讨论不绝于耳,各色名目的大模型评测应运而生。作为国内最权威的考试之一,高考覆盖各类学科及题型,同时在开考前属于“绝密”,非常适合用来作为考查大模型智能水平的评测工具,堪称大模型综合能力的“试金石”。

连日来,一些专业机构纷纷下场,使用市面上常见的大模型产品如通义千问、字节豆包、讯飞星火、文心一言、腾讯元宝、Kimi等作为“考生”,围绕“大模型高考测试”得出了一系列结果,为人们更好地了解大模型产品的性能和特点提供了参考样本。

AI高考数学全不及格?换个打开方式试试

近期,一则“AI高考测试出分,数学全不及格”的消息登上“热搜”。

消息出自上海人工智能实验室旗下司南评测体系OpenCompass对7个开源大模型进行的高考“语数外”全卷能力测试。据OpenCompass于6月19日发布的评测结果,大模型的语文、英语考试水平还不错,但数学都不及格,最高分也只有75分(满分150分)。

参加OpenCompass此次高考测试的大模型,分别来自阿里巴巴、零一万物、智谱AI、上海人工智能实验室、法国Mistral的开源模型。OpenCompass称,因无法确定闭源模型的更新时间,此次评测没有纳入商用闭源模型,仅引入GPT-4o作为评测参考。

对于数学测试全部不及格,OpenCompass表示,“大模型在数学方面还有很大的提升空间”。

不过,复旦大学自然语言处理(NLP)实验室LLMEVAL团队主持的高考数学评测显示,大模型数学成绩不佳的结果,可能缘于“打开方式不对”。

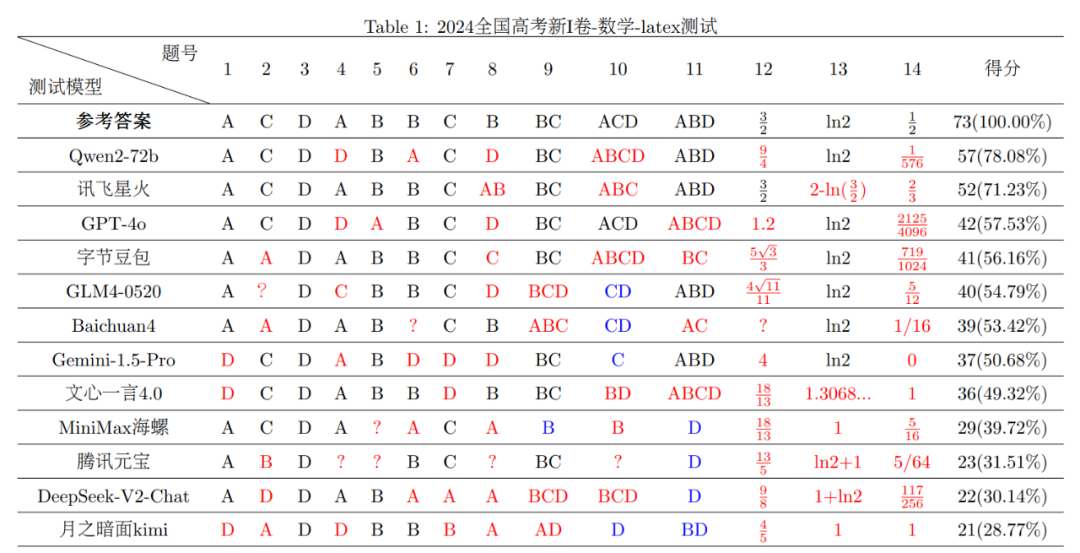

首先,LLMEVAL团队选取了2024年高考新I卷、新II卷数学试卷的客观题(单选、多选和填空题,共73分)来评测,得出了不同的结论。使用客观题测试大模型的好处是,对就是对,错就是错,结果一目了然。同时主观题由于解题方法、思路存在差异,具有一定的主观性,如果结果不正确,很难客观地评出步骤分。

其次,此次大模型“考生”增加到12个:阿里巴巴Qwen2-72b、讯飞星火、GPT-4o、字节豆包、智谱GLM4-0520、百川智能Baichuan4、谷歌Gemini-1.5-Pro、文心一言4.0、MiniMax海螺、腾讯元宝、月之暗面Kimi、DeepSeek-V2-Chat。

另外,他们在评测中发现,数学问题的不同格式的提示输入(Prompt)对大模型性能影响很大。在最初的评测中,LLMEVAL团队对数学题目中的公式部分采用了通过光学字符识别(OCR)后输出的格式(转义符格式),最新一次评测则使用了Latex格式进行了横向对比评测。

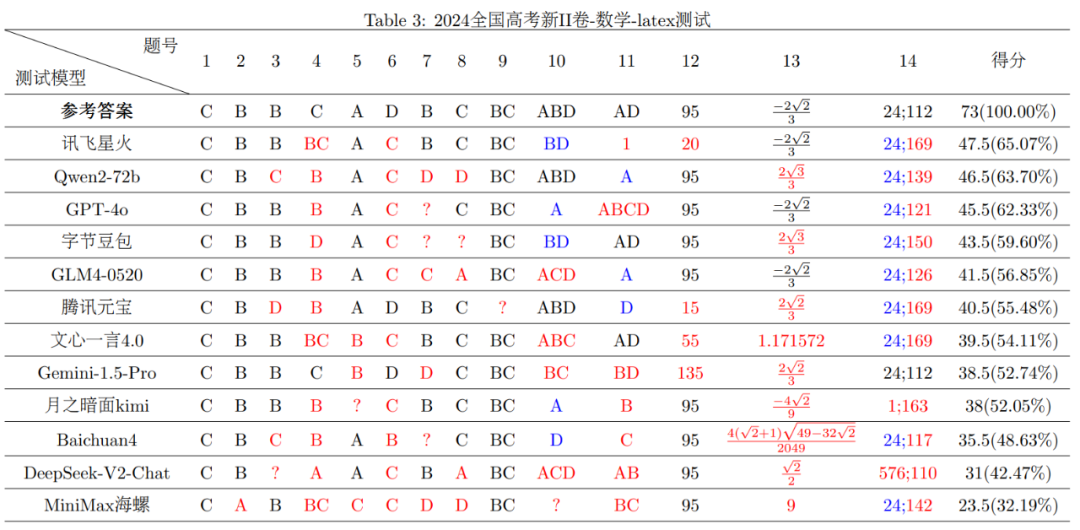

结果显示,大多数模型两次测试结果出现较大差异,不过使用Latex格式后,大模型整体表现更佳:2024年全国高考新I卷、新II卷数学测试中,得分率超过50%的大模型产品数量由此前的5个和6个升至7个和9个。考虑到Latex格式更符合人类实际使用大模型时所采用的格式,LLMEVAL团队建议后续测试主要基于此格式。

具体而言,LLMEVAL团队使用Latex格式Prompt的测试结果显示,在2024全国高考新I卷数学测试中,阿里巴巴Qwen2-72b、讯飞星火的得分率均超过及格线(60%),分别为78.08%和71.23%;在2024年全国高考新II卷数学测试中,讯飞星火、阿里巴巴Qwen2-72b和GPT-4o的得分率也超出了及格线,分别为65.07%、63.70%、62.33%。

Latex格式Prompt测试结果。来源:复旦大学NLP实验室

由此可见,大模型在数学方面并非热搜所说那般完全不及格,讯飞星火、阿里巴巴Qwen2-72b等国产大模型在高考数学客观题中具有较高的准确率,令人眼前一亮。当然,LLMEVAL团队在评测后也指出,大模型在数学推理任务中的鲁棒性与准确性仍有很大的提升空间。

语文、英语高考测试,作文见真章

“AI考生”之于语文、英语高考,最引人瞩目的当数大模型的作文水平了。

对于考生而言,作文考试主要考查学生运用语言成文的能力,考查的是识字情况、用词组句的能力以及表达事实、思想或观点的能力。事实上,作文也是最能考验大模型语言理解能力和文本生成能力的测评工具,这两项能力正是时下大模型最为倚重的。

2024年全国高考语文科目考试一结束,就有不少场外师生使用市面上的大模型产品“写作文”。围绕新课标I卷高考作文题“答案与问题”、新课标II卷“抵达未知之境”、北京高考(1)(2)卷的作文题“历久弥新”和“打开”等题目,文心一言、讯飞星火等多家大模型产品纷纷化身“写手”,并纷纷交出“作品”。

一些大模型作文令人眼前一亮。以全国新高考I卷的作文题为例,在这个具有思辨性的题目引导下,大模型提交的部分作文题不仅切题,更显巧妙,如《问,岂可少?》《疑问如春芽,答案似剪刀》《于无疑处生疑,方是进矣》《问题不止,智慧无穷》《智涌未来,问海无涯》,等等。

近日,全国中小学生作文竞赛评委、中学语文教研专家吕政嘉和河南省基础教育教学专家库成员李来明共同对市面上7款大模型产品的上述4张试卷的作文进行了评测打分。从打分情况来看,讯飞星火、文心一言4.0、腾讯元宝在4张试卷的作文题上均有不俗表现,最高平均得分接近50分。

能拿50分的AI作文长啥样?讯飞星火作出的《问,岂可少?》得到均分51.5的评分。李来明对该文的评语为,“全文结构完整,思路清晰,论证层层递进,结构框架清晰明了。全文多处扣题生发议论,鞭辟入里,分析得当。但在一些地方,可以适当增加一些论证手法,使文章更加生动有趣。”

在高考英文作文题目“帮李华写邮件”中,中国外语教育研究中心特约研究员、知名教研策划专家周国荣和广东国家级示范校教师杨菁菁也对上述7款大模型产品的英语作文进行了评测和打分。他们将2024年高考真题作文要求输入7款大模型产品,生成作文后,由教研双评产生评分和最高分点评。

全国高考卷的英语应用文写作题中,7款大模型产品均能完成试题规定的写作任务,结构上也能做到逻辑清晰、结构合理。其中不乏作品能够使用复杂句式,在语言表达上有多处亮点。但这些文章也有一些明显的扣分项,如使用超纲词汇、超过字数上限等。打分方面,7款产品均有超过12分(满分15分)的表现,且得分相对稳定。

在难度更高的全国高考英语卷“读后续写”题目和北京卷英语作文题中,7款大模型产品的表现开始有了差别。周国荣和杨菁菁的打分和点评显示,讯飞星火、腾讯元宝在“读后续写”题目中高分领先;在北京卷英语作文题中,讯飞星火、Kimi、文心一言4.0排前三位。综合来看,国产大模型在中国高考的表现并不落下风,有着教育行业背景的讯飞星火大模型还在一众大模型中表现抢眼,堪称“更会做题的大模型”。

评测,还有很长路要走

评测作为对机器理解、处理、应用自然语言能力的一种评估和量化手段,是大模型领域技术水平和研究进展的直观体现,是相关研究的工具和重要驱动力。

北京大学计算语言学研究所教授穗志方在日前“大模型+计算语言”专题论坛上的报告中表示,大模型在人类标准化考试中如中国高考、公务员考试、美国SAT考试等的表现,能够为其在真实世界中的能力提供评估参考,但仍存在一些问题。如一些模型在诸如SAT数学测试等任务中表现优异,但在复杂推理或特定知识领域中的表现却又不够出色。截然相反的表现,让人无从评判。

“在大模型内在机理没有探究清楚的情况下,我们目前的评测路径只能依靠从外部表现来推测内在能力。”穗志方说,现有评测仍存在规范性、系统性及科学性方面的问题,评测的深度和广度方面有待改进。

她提出,未来大模型评测应当以具有综合考查能力的类人机器语言能力评测为目标,在参考信度、难度、效度三大原则的基础上,应发展更系统的评测大纲、更具挑战的评测任务、更科学的评测方法,采取更多样、更鲁棒的评测手段,科学高效地为大模型提供客观、公平、类人的评测结果。如此,方能引领和推动人工智能领域各类模型、方法的提出和创新。

| 分享1 |